本文共 706 字,大约阅读时间需要 2 分钟。

一、理论

线性回归包括一元线性回归和多元线性回归,一元的是只有一个x和一个y。对于只有一个自变量x和一个因变量y的数据集,我们假设(x,y)之间的关系可以用

进行映射,把求解这个函数的过程称为线性回归求解。

二、线性回归

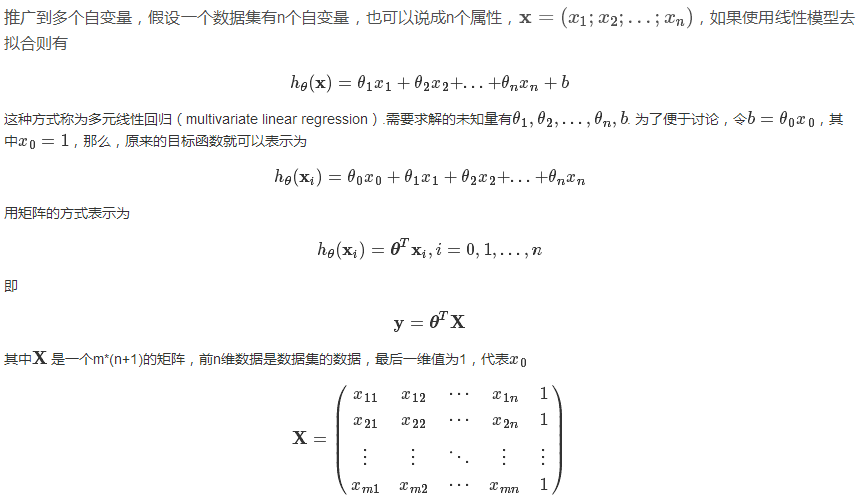

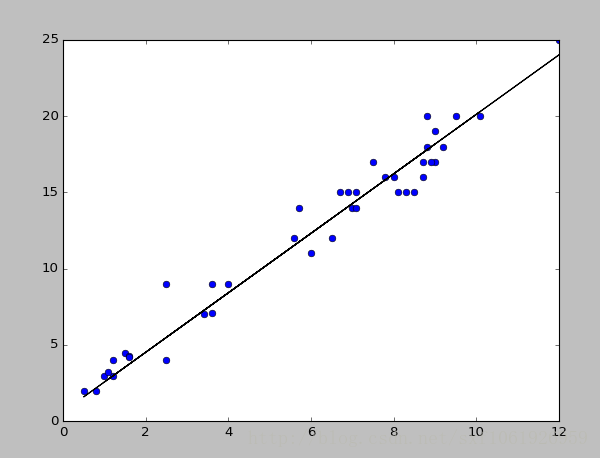

一元线性回归其实就是去找到一条直线,这条直线能以最小的误差(Loss)来拟合数据。

1、线性回归试图学得:

2、如何确定w和b?

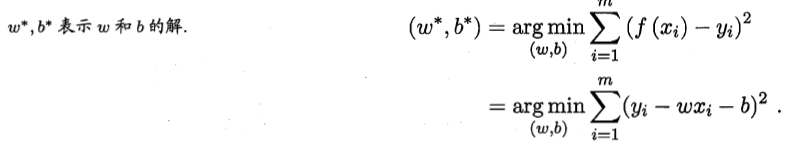

关键在于衡量f(x)和y之间的差别,就是使得误差最小。均方误差(亦称平方损失)来衡量误差,即

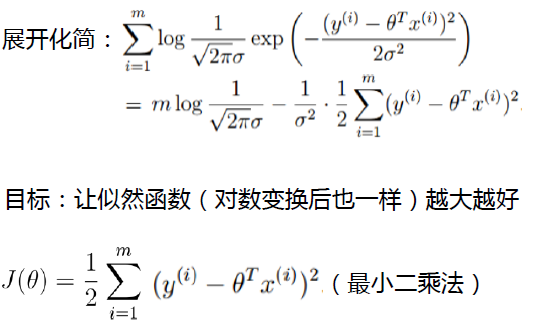

均方误差对应了常用的欧几里得距离,简称“欧氏距离”。基于均方误差最小化来进行模型求解的方法称为“最小二乘法”。

在线性回归中,最小二乘法就是试图找到一条直线,使得所有样本到直线上的欧氏距离之和最小。

求解w和b使

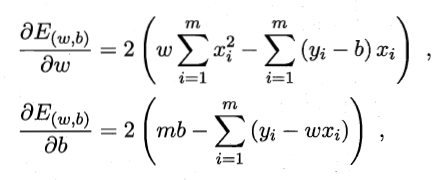

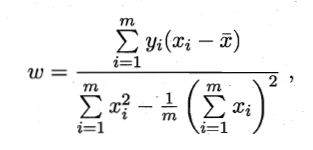

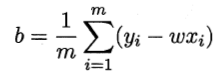

令偏导数等于0,求解得:

以上是一元线性回归模型参数的求解。

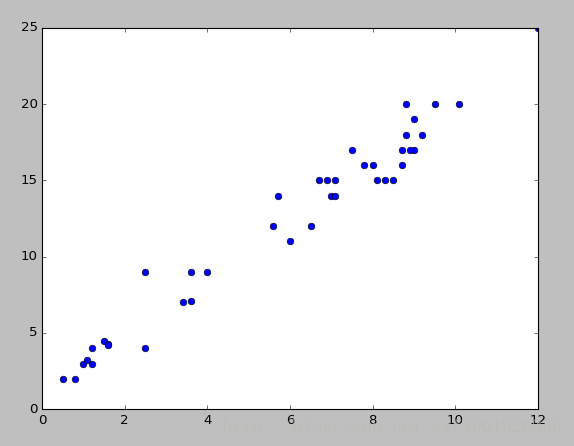

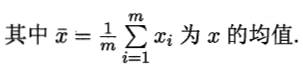

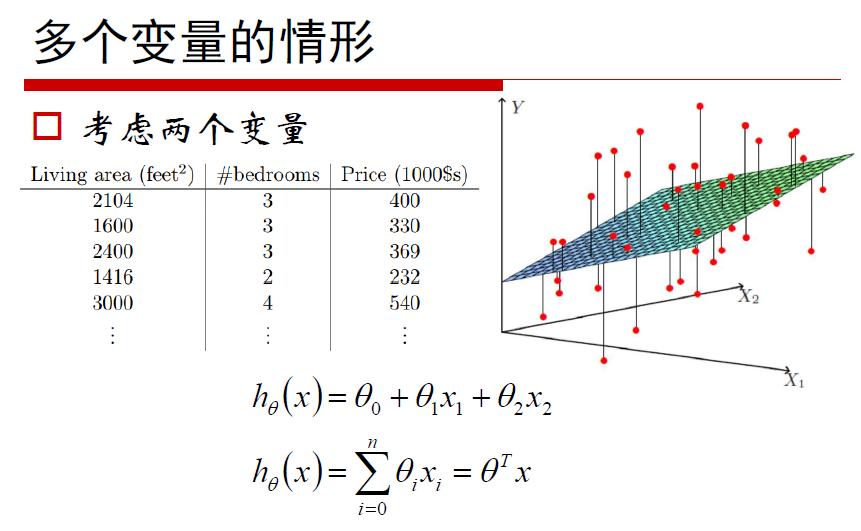

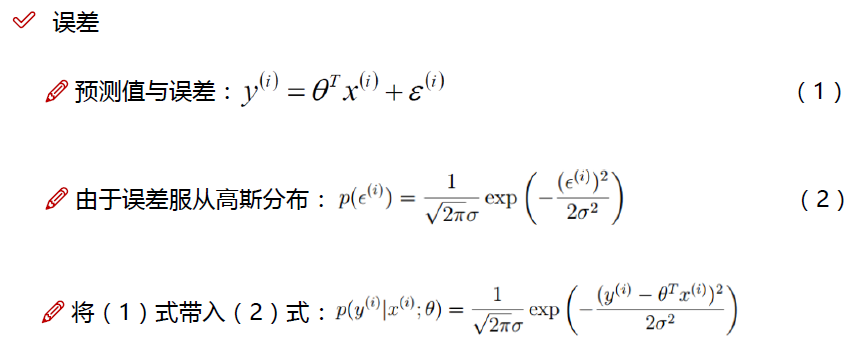

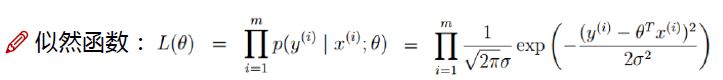

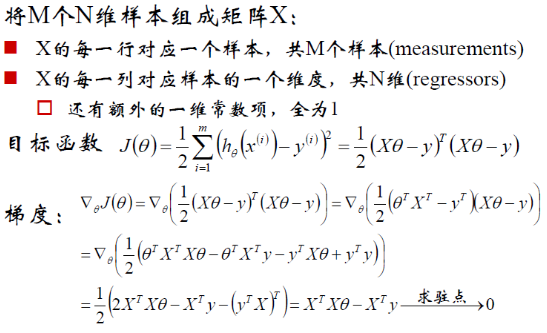

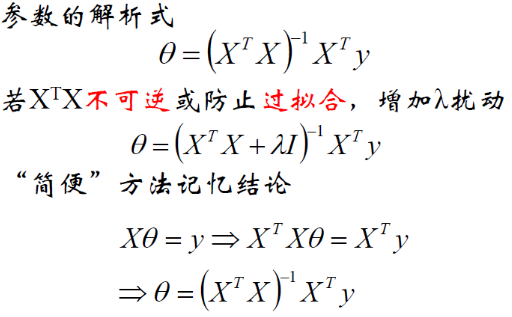

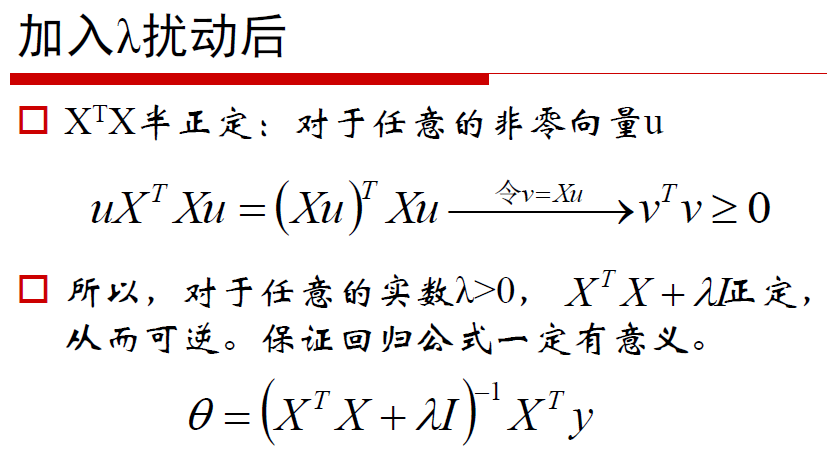

三、 对于一般的情形,线性回归参数的求解过程是:

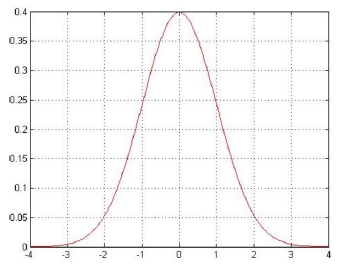

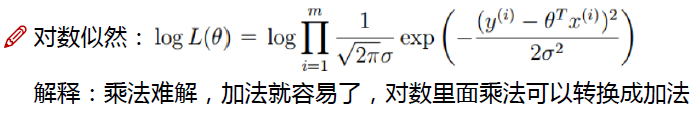

解释:在数理统计学中,似然函数是一种关于统计模型中的参数的,表示模型参数中的似然性。似然函数在中有重大作用,如在和之中的应用等等。“似然性”与“或然性”或“”意思相近,都是指某种事件发生的可能性。

但是在中,“似然性”和“或然性”或“概率”又有明确的区分。概率用于在已知一些参数的情况下,预测接下来的观测所得到的结果,而似然性则是用于在已知某些观测所得到的结果时,对有关事物的性质的参数进行估。

四、梯度下降法

最小二乘法可以一步到位,直接算出m和b,但它是有前提的,需要矩阵满秩(如果不加扰动的话)。梯度下降法和最小二乘不一样,它通过一步一步的迭代,慢慢的去靠近到那条最优直线。

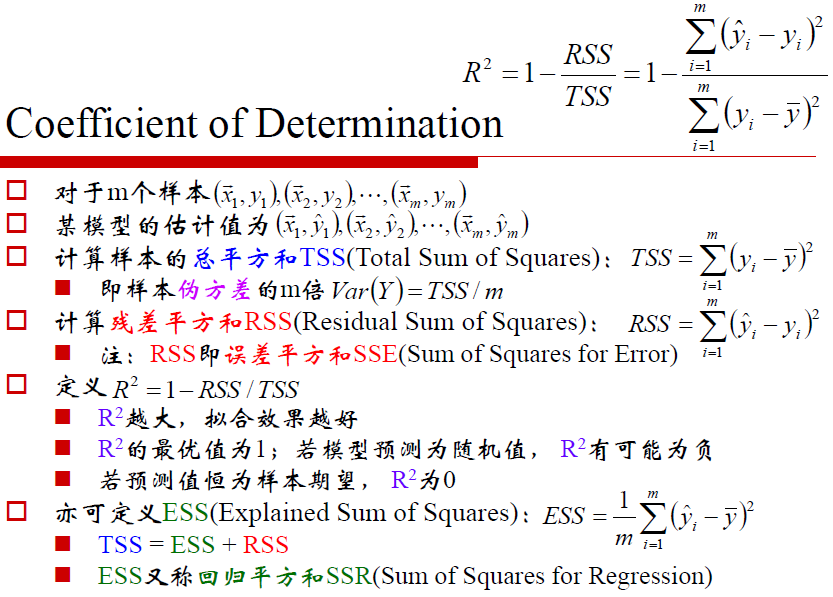

梯度下降算法的评估

补充链接: